课程介绍

从2020年底开始,Transformer 在 CV 领域中有了大幅度性能上的提升,这就表明 CV 和 NLP 在 Transformer 结构之下达成统一。目前来看,基于Attention机制的Transformer在NLP, CV, 3D Point Cloud 领域都取得了非常好的效果,并且Transformer的应用范围正在不断扩展到其他更多的细分领域中。与此同时,对于Transformer的网络结构设计、改进,理论研究,新的Attention机制探索都在蓬勃发展中。作为深度学习技术发展历史中的一个重要工作,Transformer很有可能逐渐演变为类似于LSTM, GRU的基本模块供后来研究者使用。因此无论是学术界的研究人员,还是工业界的相关从业者,都有必要对Transformer技术深入了解,并且紧跟Transformer的前沿研究(包括ViT, DETR, Mobile-Transformer, TimeSformer, Uniformer 等 ),以此来夯实自己技术积累。

本次课程通过知识讲解+项目实践的方式,让学员掌握各类CV Transformer模型的原理、结构、实现方法和调参技巧,并全面了解Transformer模型在CV中的应用。学习过程中,可以通过实现基于Transformer模型的图像识别与目标检测项目,开拓眼界,拓展思路,从而真正提高自己解决问题能力。

课程亮点

全面的技术知识讲解

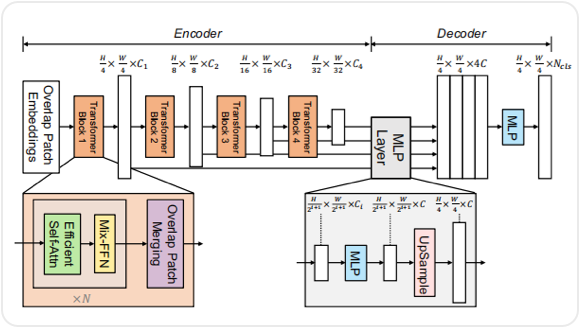

课程内容涵盖Bert/ViT/SegFormer/DETR/UP-DETR/TimeSformer/DeiT/Mobile-Transformer/Efficient Transformer/SwinTransformer/Point Transformer/MTTR/MMT/Uniformer等10余个模型的讲解

项目实践,学以致用

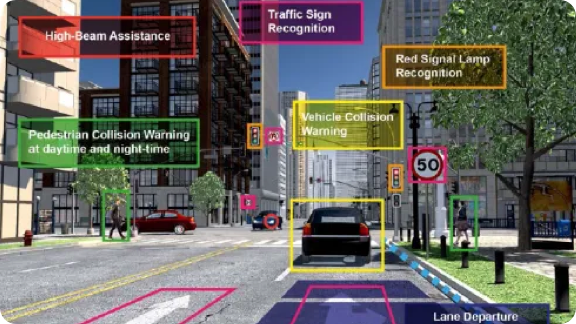

学员使用Transformer模型,练习CV领域应用最广泛的图像识别和目标检测任务。

专业团队严格打磨的课程内容,前沿且深入

课程内容经过前期数百小时的打磨设计,保证内容和项目节点设置合理,真正做到学有所得。

就业导向,目标明确

顺利完课后,优秀学员可获得字节、阿里、腾讯、美团等各互联网大厂,及商汤、旷视等AI独角兽公司的合作内推面试机会。

课程大纲

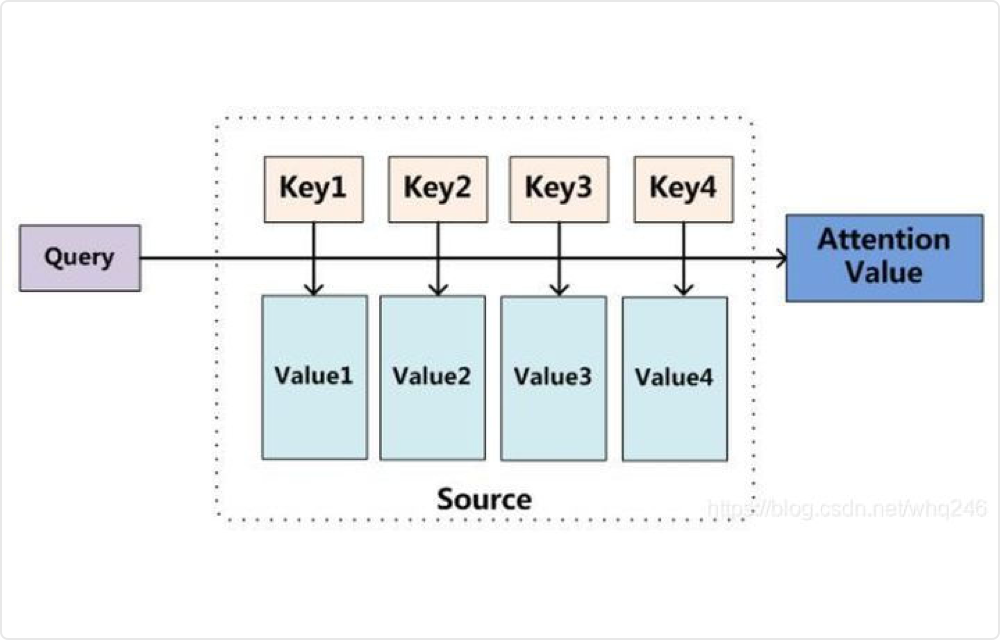

- 本节课将带领大家回顾NLP领域中Transformer/Bert技术。以此深入了解Transformer/Bert技术细节,算法优势。方便学生进一步学习Transformer 技术在其他领域的应用。

- 基于第一节课的内容,进一步研究如何将Transformer思想迁移到两个计算机视觉中分类问题的应用: 图像分类,图像语义分割。以两个经典结构ViT, SegFormer为例,让学生体会如何将Transformer应用到视觉领域的思想。

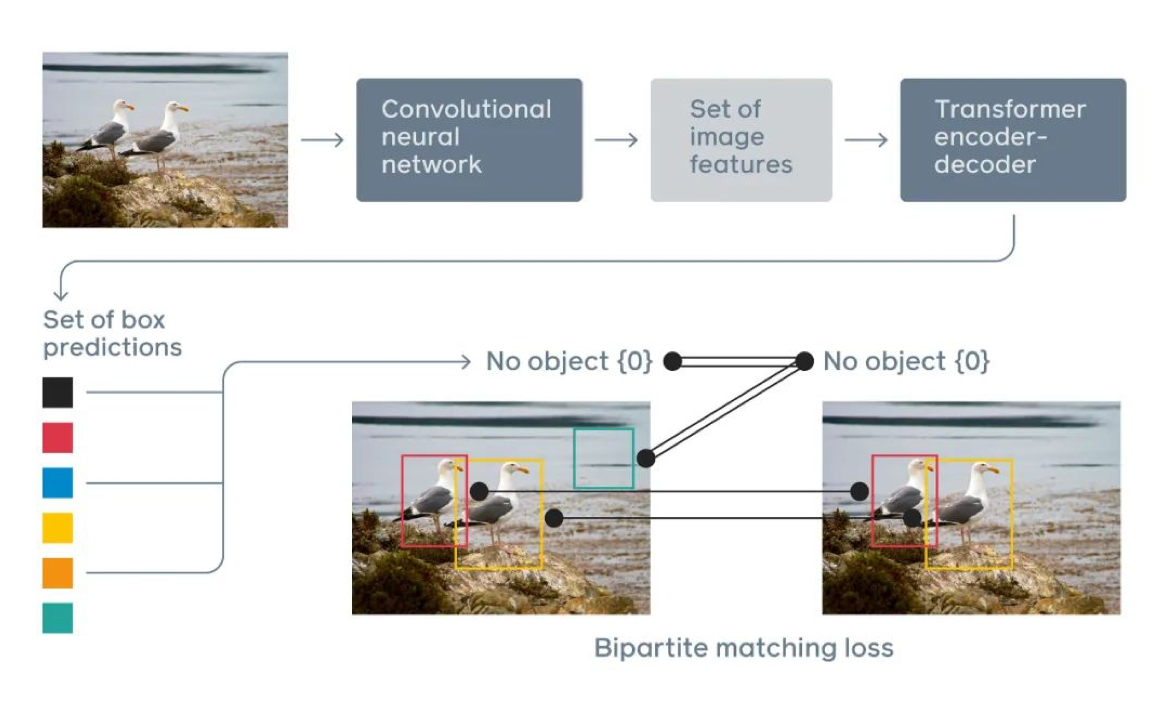

- 本节课将进一步学习如何将Transformer技术应用到目标检测任务重。特别是如何设计Transformer网络结构让神经网络能够同时学习到目标的类别信息与位置信息。

- 本节课将进一步学习如何将Transformer技术应用到视频理解应用中,让Transformer能够同时学习时序上空间上的相关性。以TimeSformer为例,让学生能够深刻体会其中设计思想。

- 高效的Transformer一直是研究者孜孜不倦的追求目标。这次课程将讨论如何设计高效的Transformer 网络结构。本节课将以DeiT, Mobile-Transformer为例,深入学习高效设计网络过程中需要注意的事项。

- 本次课程将以SwinTransformer 模型为例,系统性学习SwinTransformer以及其变种模型。目的是让学生能够进一步体会将Transformer应用到视觉任务的网络设计过程中需要注意的问题,有哪些巧妙的思想以及如何通过合理的设计做到并行计算。

- 本节课将跟大家分享3D Point Cloud中的Transformer应用。根据3D Point Cloud数据特点,我们将深入探讨如何设计合适的Transformer网络来处理海量、无结构的点云数据。同时如何进一步修改Transformer结构如何对点云进行分割,聚类等任务。

- 本节课我们将学习multi-modality 中Transformer设计问题。Transformer 在不同的领域得到了很好的应用。最近的工作在探究如何设计合适的Transformer结构处理多模态的数据。我们将以MTTR, MMT, Uniformer等相关Transformer为例子做讲解。

项目部分

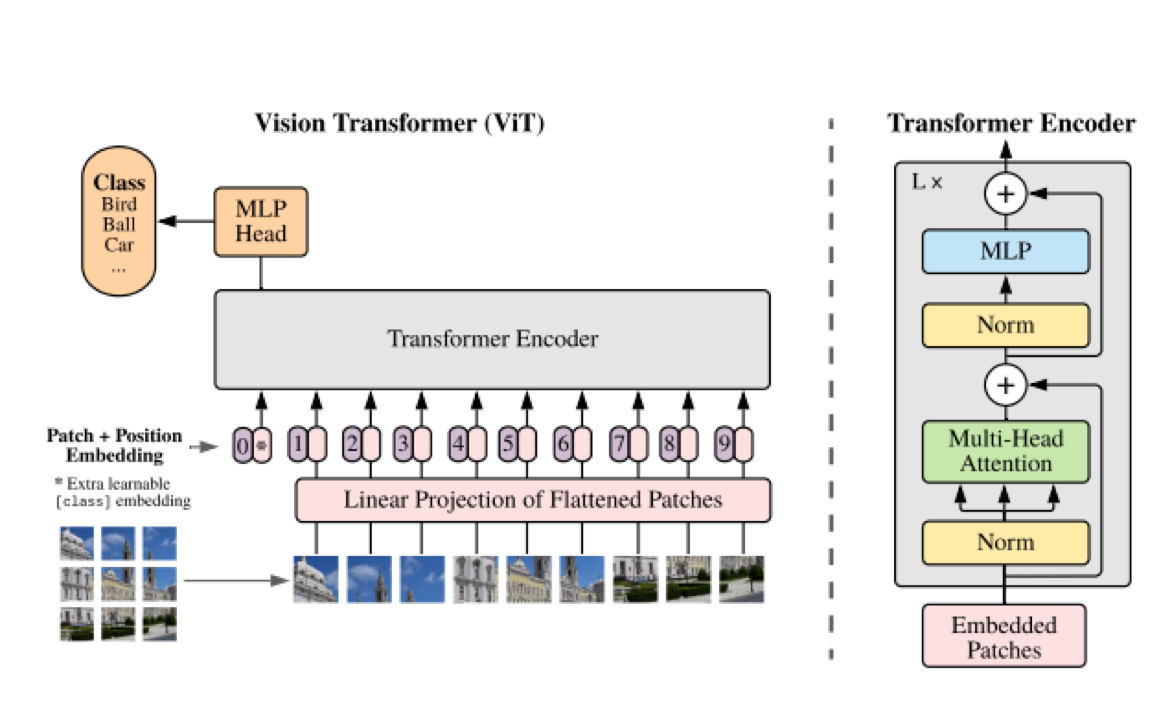

基于ViT 模型的图像识别系统

项目内容描述:作为Transformer在视觉领域的一个经典应用案例,ViT模型第一次将NLP领域中Transformer思想应用到图像领域,为后续的一系列Transformer in Vision 设计工作都提供了很好的思路启发。追根溯源,我们将以ViT模型做图像分类任务为例,开启一段如何将Transformer思想应用到视觉领域之旅。

项目使用的算法:ViT model;Cross-entropy loss;Multi-label/multi-class classification;Self-attention;LSTM/GRU

项目使用的工具:Python;Pytorch;OpenCV;ViT

项目预期结果:首先让学生自己动手实现ViT模型,在数据集上测试结果。然后根据官方的实现做对比,如果差异较大需要自己查找原因。掌握如何将Transformer中token, self-attention 思想应用到图像领域。触类旁通,希望学生能够在深刻理解的基础上,能够学生将Transformer思想用到其他相关问题中去。掌握ViT的训练方法,让学生跑完这个pipeline。从数据准备,模型训练,参数调节,到模型测试,指标计算等。

项目对应第几周的课程:1-3周

基于SwinTransformer 模型的图像分类,目标检测任务

项目内容描述:我们在上一个项目中学习了ViT模型,一个成功将Transformer应用到视觉分类问题的视觉Transformer模型。但是ViT模型的设计还是比较单一,存在一些不足。尤其是对图像中存在的问题,例如尺度变换问题没有很好的解决,并且没有考虑到效率问题。在本项目中,我们将学习另一个进阶版的视觉Transformer模型: SwinTransformer模型。

项目使用的算法:SwinTransformer;Cross-Entropy Loss;Regression Loss;Forward-Backward Propagation

项目使用的工具:Python;Pytorch;OpenCV

项目预期结果:学生自己实现SwinTransformer代码(也可参照官方实现),并且参照官方实现优化自己的实现,如果实验效果差异较大,学生需要查找原因。体会用SwinTransformer来做目标检测的思想。掌握如何从代码角度优化实现SwinTransformer的self-attention机制从局部扩展到全局。学生掌握如何将Transformer思想应用到自己工作或者学习中的实际问题中去。

项目对应第几周的课程:6-7周

授课方式

基础知识讲解

前沿论文解读

该知识内容的实际应用

该知识的项目实战

该知识的答疑解惑

该方向的知识延伸及未来趋势讲解

课程研发及导师团队

你将收获

全面掌握Transformer在CV领域的知识,灵活应用在自己工作中

能够了解各类Transformer模型的实现方式,并熟练掌握其关键技术与方法

深入理解前沿的Transformer模型技术,拓宽工作和研究的技术视野

短期内对一个领域有全面且系统的认识,大大节省学习时间

认识一群拥有同样兴趣的人、相互交流、相互学习

适合人群

大学生

在职人士

入学标准

掌握python

具备Pytorch或者TensorFlow 基础知识

具备神经网络基本知识

具备深度学习模型训练